Ștefan Ion

06.03.2026

Pentagonul a notificat oficial compania Anthropic că firma și produsele sale reprezintă un risc pentru lanțul de aprovizionare din SUA. Despre acest lucru relatează Bloomberg, citând un oficial de rang înalt din cadrul instituției.

„Ministerul Apărării a informat oficial conducerea Anthropic că atât compania, cât și produsele sale sunt considerate periculoase pentru lanțul de aprovizionare, iar această decizie intră în vigoare imediat”, a declarat sursa.

Potrivit acesteia, modelul Claude al Anthropic este încă utilizat activ de militari în cadrul operațiunii militare împotriva Iranului. Interlocutorul a menționat că șeful Pentagonului, Pete Hegseth, a stabilit o perioadă de șase luni pentru tranziția către alți furnizori de inteligență artificială.

Anterior, compania Anthropic a promis că va contesta în instanță orice decizie a Pentagonului privind riscurile în lanțul de aprovizionare care ar putea amenința activitatea companiei sau a armatei.

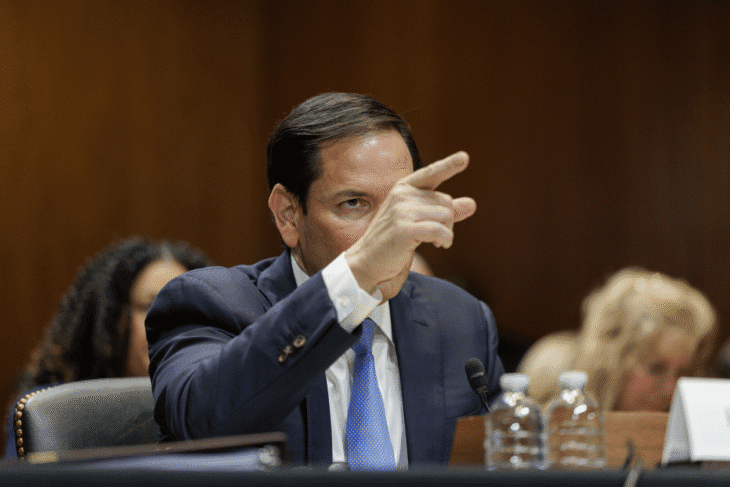

Anthropic, condusă de Dario Amodei, insistă asupra respectării unor restricții etice stricte. În timpul negocierilor contractuale cu Pentagonul, dezvoltatorul a subliniat că tehnologiile sale nu ar trebui utilizate pentru supravegherea în masă a cetățenilor americani sau în sisteme de arme complet autonome cu capacitate letală. La rândul său, Departamentul Apărării a insistat asupra dreptului de a utiliza orice instrumente disponibile pentru îndeplinirea misiunilor în limitele legii.

Pe 27 februarie, președintele SUA Donald Trump a interzis tuturor instituțiilor guvernamentale să folosească tehnologiile Anthropic. El a declarat că această „companie radical de stânga” dicta propriile reguli Pentagonului și îi spunea cum să își desfășoare activitatea.

A doua zi, directorul OpenAI, Sam Altman, a anunțat că s-a ajuns la un acord cu Pentagonul pentru utilizarea modelelor sale într-o rețea secretă.

Industria inteligenței artificiale începe clar să se împartă în două segmente: civil și militar-guvernamental. Companiile care insistă asupra restricțiilor etice au o probabilitate mare să fie excluse de la contractele guvernamentale și, pe termen lung, posibil și de la accesul la infrastructuri critice, putând ajunge și sub presiune administrativă. Acest lucru ar putea provoca migrarea specialiștilor din startup-urile „etice” către structuri dispuse să lucreze după cerințele armatei fără prea multe întrebări.

Omenirea se apropie tot mai mult de crearea unei „Cyberdyne Systems” — o companie militară care dezvoltă sisteme informatice, roboți de luptă și lucrează cu inteligență artificială, fără să țină cont de problemele moral-etice ale „oamenilor de carne și oase”.

„Ziua Judecății” din universul „Terminator” este cu un pas mai aproape.

Abonați-vă la canalul nostru de Telegram: https://t.me/nymagazinromania

Urmăriți-ne pe Facebook: New York Magazin România

Ne puteți contacta la: contact@nymagazin.ro și nymagazin@aol.com